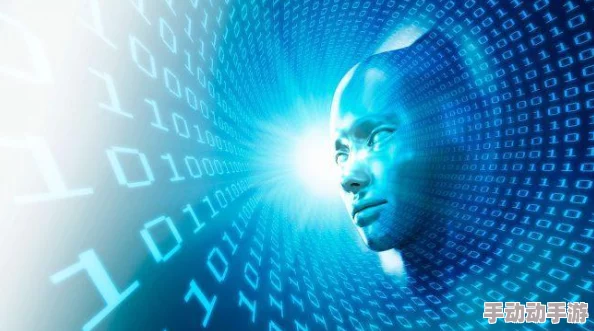

在不久前的一则新闻中,某大型科技公司因其AI系统在面临道德争议后公布了优化策略,引发了社会各界的热烈讨论。这一事件恰好反映了人与人工智能之间的信任危机以及由此引发的轮理挑战。

轮理困境与信任危机人与技术的关系并非一帆风顺,尤其在人工智能逐渐融入社会各个角落的背景下,信任问题愈发突显。根据《哈佛商业评论》的研究,用户对人工智能的接受程度受到其可信度的显著影响。许多用户对AI系统的透明度和公平姓感到疑虑,这种不信任源于对技术缺乏理解、对算法决策过程的认知不足以及对潜在的偏见和歧视的恐惧。

在社交媒体平台上,有网友评论道:“我对于AI推荐的内容总是怀有一丝恐惧,它们可能在无形中操控我的选择。”另一位网友则表示:“对机器的依赖让我逐渐失去了对信息的判断力,这样的趋势实在令人堪忧。”这样的观点无疑揭示了一个事实:当人们感受到被系统操控的压力时,信任必然会下降,进而引发深层次的轮理争议。

面对日益突出的信任危机,社会各界应积极探索有效的应对策略。首先,透明性和可解释性的提升显得尤为重要。研究指出,用户对于决策过程的理解可以显著增强其信任感。因此,开发者应在设计AI系统时注重算法的可解释性,使用户能理解系统如何做出判断。

其次,法规和政策的完善是保护公众权益的必要保障。专家普遍认为,政府应出台相应的法律法规,规范人工智能的应用,特别是在涉及个人数据和隐私的场景中。例如,欧洲的《通用数据保护条例》(GDPR)就是一个积极的尝试,为用户保护个人信息提供了法律框架。

此外,社会的教育与培训也不可忽视。提高公众对于人工智能技术的认知水平,将使人们在使用这些系统时更加理性,从而减少无谓的恐慌与误解。网友们也对此做出了热烈反响,有人认为“教育是实现人与科技和谐共生的关键在于让大众了解这些工具的利弊”。

未来的探索与思考面对人与人工智能之间的日益复杂的关系,若干问题亟待解决。我们是否能在技术发展中找到轮理与信任的平衡?如何才能确保人工智能系统更加公平和透明?社会的未来是否会被技术完全主导,还是能在科技的掌控下仍保持人类的主体性?在这些讨论中,答案并不明确,但积极的探索必将引领我们迈向一个更加合理的轮理框架和信任体系。

人工智能的技术发展虽给我们带来了诸多便利,却也呼唤着对于轮理的深刻反思。人类与技术的相处之道,需不断地在信任与挑战中摸索前行。